Difference between r1.12 and the current

@@ -1,11 +1,15 @@

[[pagelist(^(머신러닝스터디/2016))]]

[머신러닝스터디/2016]

[머신러닝스터디/2016/목차]

== 내용 ==* [https://github.com/aymericdamien/TensorFlow-Examples/blob/master/examples/2%20-%20Basic%20Classifiers/logistic_regression.py Logistic Regression(Binary Regression)]

https://upload.wikimedia.org/math/8/e/a/8ea0a810cfcd0c3dfec49306e214e301.png

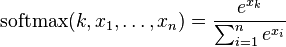

* Softmax

* exponential을 쓴다.

* 항상 양의 값을 가지며 단조 증가한다는 특징을 가짐.

* exponential을 쓴다.

* 아래는 Tensorflow API 정의

{{{softmax[i, j] = exp(logits[i, j]) / sum(exp(logits[i]))}}}

* exponential은 항상 양의 값을 가지며 단조 증가한다는 특징을 가지기 때문에 확률 계산에 적합하다.

* TensorFlow에서 지원하는 기능

* 예를 들어 784,00개의 데이터를 넣어주면 자동으로 행렬이 100 * 784로 형성된다.

내용 ¶

- Logistic Regression(Binary Regression)

- Softmax

- exponential을 쓴다.

- 아래는 Tensorflow API 정의

- exponential을 쓴다.

- exponential은 항상 양의 값을 가지며 단조 증가한다는 특징을 가지기 때문에 확률 계산에 적합하다.

- None

- TensorFlow에서 지원하는 기능

- 예를 들어 784,00개의 데이터를 넣어주면 자동으로 행렬이 100 * 784로 형성된다.

- TensorFlow에서 지원하는 기능

- TensorFlow에서는 행렬과 백터의 합이 지원이 된다.

- 정확히는 m*n 크기의 행렬 A에 n*1의 백터 B를 더하면 m개의 행에 각각 백터 B가 더해진다.

- 정확히는 m*n 크기의 행렬 A에 n*1의 백터 B를 더하면 m개의 행에 각각 백터 B가 더해진다.

- TensorFlow API

- 가장 중요한 것은 graph의 shape

softmax[i, j] = exp(logits[i, j]) / sum(exp(logits[i]))후기 ¶

다음 시간에는 ¶

- Logistic Regression Live Coding?